Akti i IA është kuadri i parë ligjor për IA, i cili trajton rreziqet e IA dhe e pozicionon Evropën të luajë një rol udhëheqës në nivel global.

Akti i IA siguron për zhvilluesit e IA kërkesa dhe detyrime të qarta në lidhje me përdorimet specifike të IA. Në të njëjtën kohë, rregullorja synon të zvogëlojë barrën administrative dhe financiare për biznesin, në veçanti ndërmarrjet e vogla dhe të mesme (SME).

Akti i IA është pjesë e një pakete më të gjerë masash politikash për të mbështetur zhvillimin e besueshëm të IA, e cila përfshin gjithashtu Paketën e Inovacionit IA dhe Planin e Koordinuar për IA. Së bashku, këto masa garantojnë sigurinë dhe të drejtat themelore të njerëzve dhe bizneseve kur bëhet fjalë për Inteligjencën Artificiale. Ata gjithashtu forcojnë marrjen, investimet dhe inovacionin në IA në të gjithë BE-në.

Ky akt është korniza e parë ligjore gjithëpërfshirëse për IA në mbarë botën. Qëllimi i rregullave të reja është të nxisë inteligjencën artificiale të besueshme në Europë dhe më gjerë, duke siguruar që sistemet e IA të respektojnë të drejtat themelore, sigurinë dhe parimet etike dhe duke adresuar rreziqet e modeleve shumë të fuqishme dhe me ndikim të IA.

Pse na duhen rregulla për IA?

Akti i IA siguron që europianët mund të besojnë atë që IA ka për të ofruar. Ndërsa shumica e sistemeve të IA nuk paraqesin rrezik të kufizuar dhe mund të kontribuojnë në zgjidhjen e shumë sfidave shoqërore, disa sisteme të AI krijojnë rreziqe që ne duhet t’i adresojmë për të shmangur rezultate të padëshiruara.

Për shembull, shpesh nuk është e mundur të zbulohet pse një sistem AI ka marrë një vendim ose parashikim dhe ka ndërmarrë një veprim të veçantë. Pra, mund të bëhet e vështirë të vlerësohet nëse dikush ka qenë padrejtësisht në disavantazh, si për shembull në një vendim punësimi ose në një aplikim për një skemë të përfitimit publik.

Megjithëse legjislacioni ekzistues ofron njëfarë mbrojtjeje, ai është i pamjaftueshëm për të adresuar sfidat specifike që mund të sjellin sistemet e IA.

Rregullat e reja:

Të adresojë rreziqet e krijuara posaçërisht nga aplikacionet e IA

Të ndalojë praktikat e IA që paraqesin rreziqe të papranueshme

Të përcaktojë një listë të aplikacioneve me rrezik të lartë

Të vendosë kërkesa të qarta për sistemet e IA për aplikacione me rrezik të lartë.

Të përcaktojë detyrime specifike për vendosësit dhe ofruesit e aplikacioneve të IA me rrezik të lartë.

Kërkojnë një vlerësim të konformitetit përpara se një sistem i caktuar IA të vihet në shërbim ose të vendoset në treg.

Vendosja e zbatimit pasi një sistem i caktuar i AI është vendosur në treg.

Të krijojë një strukturë qeverisëse në nivel evropian dhe kombëtar.

Lexo: Fatbardha Rino, bankierja që kombinon profesionin me pasionin e saj për të fuqizuar komunitetin

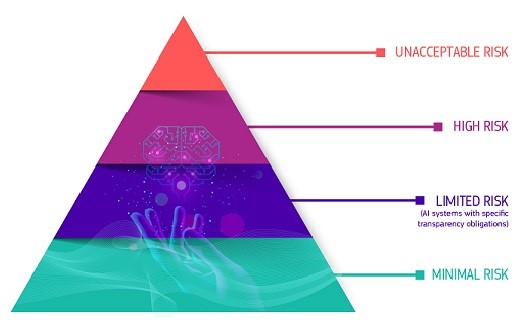

Një qasje e bazuar në rrezik

Kuadri Rregullator përcakton 4 nivele të rrezikut për sistemet e IA:

Të gjitha sistemet e IA që konsiderohen si një kërcënim i qartë për sigurinë, jetesën dhe të drejtat e njerëzve janë të ndaluar, nga instrumentat për qeveritë deri te lodrat që përdorin asistencë zanore që inkurajon sjellje të rrezikshme.

Rreziku i lartë

Sistemet e AI të identifikuara si me rrezik të lartë përfshijnë teknologjinë AI të përdorur në:

- infrastruktura kritike (p.sh. transporti), që mund të rrezikojnë jetën dhe shëndetin e qytetarëve

- formimi arsimor ose profesional, që mund të përcaktojë aksesin në arsim dhe kursin profesional të jetës së dikujt (p.sh. rezultati i provimeve)

- komponentët e sigurisë së produkteve (p.sh. aplikimi i AI në kirurgjinë me ndihmën e robotëve)

- punësimi, menaxhimi i punëtorëve dhe aksesi në vetëpunësim (p.sh. softuer për klasifikimin e CV-ve për procedurat e rekrutimit)

- shërbimet thelbësore private dhe publike (p.sh. vlerësimi i kredisë që u mohon qytetarëve mundësinë për të marrë një kredi)

- zbatimi i ligjit që mund të ndërhyjë në të drejtat themelore të njerëzve (p.sh. vlerësimi i besueshmërisë së provave)

- Menaxhimi i migracionit, azilit dhe kontrollit kufitar (p.sh. ekzaminimi i automatizuar i aplikimeve për viza)

- administrimi i drejtësisë dhe proceset demokratike (p.sh. zgjidhjet e IA për të kërkuar vendime gjyqësore.

Sistemet e inteligjencës artificiale me rrezik të lartë nënshtrohen detyrimeve strikte përpara se të hidhen në treg:

- Vlerësimi adekuat i rrezikut dhe sistemet e zbutjes

- cilësi e lartë e grupeve të të dhënave që ushqejnë sistemin për të minimizuar rreziqet dhe rezultatet diskriminuese

- regjistrimi i aktivitetit për të siguruar gjurmueshmërinë e rezultateve

- dokumentacion i detajuar që ofron të gjithë informacionin e nevojshëm për sistemin dhe qëllimin e tij që autoritetet të vlerësojnë përputhshmërinë e tij

- informacion të qartë dhe adekuat për vendosësin

- masat e duhura të mbikëqyrjes njerëzore përtë minimizuar rrezikun

- niveli i lartë i qëndrueshmërisë, sigurisë dhe saktësisë

Të gjitha sistemet e identifikimit biometrik në distancë konsiderohen me rrezik të lartë dhe u nënshtrohen kërkesave strikte. Përdorimi i identifikimit biometrik në distancë në hapësira të aksesueshme publikisht për qëllime të zbatimit të ligjit, në parim, është i ndaluar.

Përjashtimet e ngushta përcaktohen dhe rregullohen rreptësisht, si kur është e nevojshme për të kërkuar një fëmijë të zhdukur, për të parandaluar një kërcënim specifik dhe të afërt terrorist ose për të zbuluar, lokalizuar, identifikuar ose ndjekur penalisht një autor ose të dyshuar për një vepër të rëndë penale.

Këto përdorime i nënshtrohen autorizimit nga një organ gjyqësor ose një organ tjetër i pavarur dhe ndaj kufijve të duhur në kohë, shtrirje gjeografike dhe bazat e të dhënave të kërkuara.

Rrezik i kufizuar

Rreziku i kufizuar i referohet rreziqeve që lidhen me mungesën e transparencës në përdorimin e AI. Akti i AI prezanton detyrime specifike të transparencës për të siguruar që njerëzit të informohen kur është e nevojshme, duke nxitur besimin. Për shembull, kur përdorin sisteme të AI si chatbot, njerëzit duhet të ndërgjegjësohen se po ndërveprojnë me një makinë në mënyrë që të marrin një vendim të informuar për të vazhduar ose për t’u tërhequr. Ofruesit gjithashtu duhet të sigurojnë që përmbajtja e krijuar nga AI të jetë e identifikueshme. Përveç kësaj, teksti i krijuar nga AI, i publikuar me qëllim të informimit të publikut për çështje me interes publik, duhet të etiketohet si i krijuar artificialisht. Kjo vlen edhe për përmbajtjet audio dhe video që përbëjnë falsifikime të thella.

Rrezik minimal ose aspak

Akti i IA lejon përdorimin falas të IA me rrezik minimal. Kjo përfshin aplikacione të tilla si lojërat video të aktivizuara me AI ose filtrat e postës së padëshiruar. Shumica dërrmuese e sistemeve të AI që përdoren aktualisht në BE bien në këtë kategori.

Si funksionon e gjithë kjo në praktikë për ofruesit e sistemeve të AI me rrezik të lartë?

Si funksionon e gjitha në praktikë për ofruesit e sistemeve të IA me rrezik të lartë?

Sapo një sistem i IA të dalë në treg, autoritetet janë përgjegjëse për mbikëqyrjen e tregut, vendosësit sigurojnë mbikëqyrjen dhe monitorimin njerëzor dhe ofruesit kanë një sistem monitorimi pas tregtimit. Ofruesit dhe shpërndarësit do të raportojnë gjithashtu incidente serioze dhe mosfunksionime.

Një zgjidhje për përdorimin e besueshëm të modeleve të mëdha të IA

Gjithnjë e më shumë, modelet e IA me qëllime të përgjithshme po bëhen komponentë të sistemeve të IA. Këto modele mund të kryejnë dhe përshtatin detyra të panumërta të ndryshme.

Ndërsa modelet e IA me qëllime të përgjithshme mund të mundësojnë zgjidhje më të mira dhe më të fuqishme të IA, është e vështirë të mbikëqyren të gjitha aftësitë.

Atje, akti i IA prezanton detyrime transparence për të gjitha modelet e IA me qëllime të përgjithshme për të mundësuar një kuptim më të mirë të këtyre modeleve dhe detyrime shtesë për menaxhimin e rrezikut për modelet shumë të afta dhe me ndikim. Këto detyrime shtesë përfshijnë vetëvlerësimin dhe zbutjen e rreziqeve sistemike, raportimin e incidenteve serioze, kryerjen e vlerësimeve të testeve dhe modeleve, si dhe kërkesat e sigurisë kibernetike.

Duke qenë se AI është një teknologji me zhvillim të shpejtë, rregullorja ka një qasje të sigurt për të ardhmen, duke lejuar që rregullat të përshtaten me ndryshimet teknologjike. Aplikacionet e AI duhet të mbeten të besueshme edhe pasi të jenë vendosur në treg. Kjo kërkon menaxhim të vazhdueshëm të cilësisë dhe rrezikut nga ofruesit.

Zbatimi

Zyra Evropiane e IA, e themeluar në shkurt 2024 në kuadër të Komisionit, mbikëqyr zbatimin dhe zbatimin e Aktit të IA me shtetet anëtare. Ai synon të krijojë një mjedis ku teknologjitë e IA respektojnë dinjitetin, të drejtat dhe besimin e njeriut. Ai gjithashtu nxit bashkëpunimin, inovacionin dhe kërkimin në AI midis aktorëve të ndryshëm. Për më tepër, ajo angazhohet në dialogun ndërkombëtar dhe bashkëpunimin për çështjet e IA, duke pranuar nevojën për harmonizim global në qeverisjen e IA. Nëpërmjet këtyre përpjekjeve, Zyra Evropiane e IA përpiqet të pozicionojë Evropën si një lider në zhvillimin etik dhe të qëndrueshëm të teknologjive të IA.

Hapi tjetër

Ligji i IA hyri në fuqi më 1 gusht dhe do të jetë plotësisht i zbatueshëm 2 vjet më vonë, me disa përjashtime: ndalimet do të hyjnë në fuqi pas gjashtë muajsh, rregullat e qeverisjes dhe detyrimet për modelet e IA për qëllime të përgjithshme bëhen të zbatueshme pas 12 muajsh dhe rregullat për sistemet e IA – në produkte të rregulluara – do të zbatohen pas 36 muajsh. Për të lehtësuar kalimin në kuadrin e ri rregullator, Komisioni Europian ka nisur Paktin e IA, një iniciativë vullnetare që synon të mbështesë zbatimin e ardhshëm dhe fton zhvilluesit e IA nga Evropa dhe më gjerë që të përmbushin detyrimet kryesore të Aktit të IA para kohe.

Artikull ekskluziv i Business Magazine Albania.

Ky artikull gëzon të drejtën e autorësisë sipas Ligjit Nr. 35/2016, “Për të drejtat e autorit dhe të drejtat e lidhura me to”.

Artikulli mund të ripublikohet nga mediat e tjera vetëm duke cituar “Business Magazine Albania” shoqëruar me linkun e artikullit origjinal

Që nga viti 2015 nxisim shpirtin sipërmarrës, inovacionin dhe rritjen personale duke ndikuar në zhvillimin e një mjedisi motivues dhe pozitiv tek lexuesit tanë. Mbështetja juaj na ndihmon ta vazhdojmë këtë mision.

Na Suporto